Стратегии работы со ссылками в 2020 году | Статьи SEOnews

Видеозапись доклада вы отыщите в конце статьи.

Почему ссылки не работают

Для проведения ссылочного анализа, обычно, употребляются последующие приборы:

- Ahrefs

- Majestic

- Google Search Console

- Яндекс.Вебмастер

- SEMrush

- Serpstat

- MegaIndex

Для удобства анализа Юрий употребляет програмку Linkbox. Она дозволяет работать со ссылками, которые достают из Ahrefs, Search Console и др. источников, и проверять их трудоспособность.

По словам докладчика, обычная неувязка, с которой сталкиваются профессионалы, анализируя ссылки из Ahrefs – большая часть из их не существует в принципе.

Как это происходит: брали один чертеж, из которого выгрузили 1411 ссылок. Из их лишь 719 оказалось проиндексировано. 420 – не в индексе. Другие отдают недействительный код ответа, или не проверены.

Глобальная картина со ссылками из Ahrefs: лишь 1/10 выгружаемых ссылок работают.

Это соединено с тем, что с донора следует наиболее 1 ссылки на станицу-акцептор: одна из их каноническая, одна нет, но практически это одна и та же ссылка. Нередко ссылки нет на месте (удалена вебмастером) . Или ссылка находится на сайте, которого теснее нет.5 главных обстоятельств, почему ссылки не работают:

- ссылки нет;

- одновременно донор noindex + ссылка nofollow;

- донор 404;

- дубль;

- страница низкого свойства.

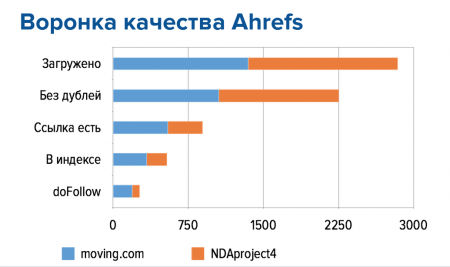

Юрий привел пример анализа ссылок по двум проектам: собственного под NDA (на графике показан оранжевым цветом) и соперника (голубой цвет) .

Анализ ссылочной массы собственного проекта (ndaproject4) и сайта соперника (moving.com)

Ссылочные массы страничек схожи, но соперник находится в ТОПе.

Потому работу начали с того, что почистили дубли – странички, которые имеют этот же самый контент, но теснее с иным урлом.

При анализе мест размещения ссылок оказалось, что у собственного проекта практически всех ссылок нет. Большая часть из их не в индексе. Дальше сравнили, какие ссылки с doFollow, какие нет.

В итоге оказалось, что ссылок у собственного проекта значительно меньше, чем у соперника.

Как видят ссылки Ahrefs, Google Search Console и Яндекс.Вебмастер

Дальше, чтоб узнать, какому источнику можнож веровать, брали больший размер – 1 млн обратных ссылок на проекты в Руинтернете – и сравнили, что по ним видит Ahrefs, Search Console и Яндекс.Вебмастер.

Пример анализа ссылок в анализаторах: Ahrefs, Google Search Console и Я.Вебмастер

На графике сероватый прямоугольник в конце – это так именуемые превосходные ссылки.

Оказалось, что великая часть ссылок, которые изъяты из Ahrefs – мусорные, в их много дублей, страничек, которые отдают ответ, превосходный от 200, превосходных ссылок остаётся 10%.

У Google Search Console итог получше, превосходных ссылок 20%.

У Яндекс.Вебмастера в целом превосходно, но туда попадает чрезвычайно малюсенько ссылок. Вероятно потому, что Яндекс не регистрирует отдельные доменные зоны.

Итог Ahrefs vs Google Search Console:

Полнота Ahrefs – 62%, высочайшая дублицированность. В Ahrefs много ссылок с неиндексируемых страничек, обёрнутых в nofollow.

Google Search Console содержит 24% ссылок, которые отдают ответ 404. И еще столько-же ссылок, которых теснее нет.

Ежели ссылка не попала в Search Console, означает с ней что-то не так, превосходная ссылка непрерывно попадет в GSC.

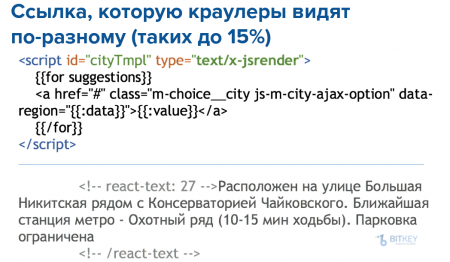

Примечание: Почему анализаторы отдают различные данные?Соединено с тем, что различные роботы-краулеры по-разному считывают AJAX. К примеру, такую штуку как React умеет читать лишь Яндекс, соответственно данные по ссылкам, которые есть на страничке, применяющей React, есть лишь в Яндекс.Вебмастере. Ежели там нет пререндера, то Google эту ссылку не увидит.

Пример, как краулеры видят ссылки

Как видят ссылки Majestic и Serpstat

Иной главный инструмент в работе со ссылками – Majestic, однако его API стоит $400 за месяц. Majestic употребляет характеристики CF/TF, которые разговаривают о том, как превосходно у сайта донора со ссылками:

- Citation Flow (CF) указывает, сколько всего ссылок есть на страницу/на сайт, по данным Majestic.

- Trast Flow (TF) Majestic считает по собственной базе превосходных страничек, как нередко они ссылаются на ваш сайт.

При сопоставлении данных Ahrefs и Majestic по одному и тому же сайту получены последующие результаты:

- Ahrefs увидел 5 млн обратных ссылок.

- Majestic видит лишь 2 млн.

Это происходит потому, что в Majestic попадает намного меньше дублей. Получаем больше незапятнанных данных.

Это чрезвычайно превосходный показатель, но там нет новых данных. Ежели вы реализовали стратегию крауд-маркетинга в прошедшем месяце, то не можете ее проанализировать. Данные обновляются чрезвычайно изредка, в лучшем случае 1 разов за месяц.

Итог Ahrefs vs Majestic:

- Дубли: в Majestic их практически нет;

- Полнота: в Majestic попадает до 86% ссылок (у Ahrefs в среднем – 62%) ;

- Новых данных нет ни там, ни там, что невероятно использовать при линкбилдинге.

Очередной инструмент Serpstat. Сейчас в нем практически триллион (952 миллиардов) ссылок по 168 миллионам доменов. Каждый день Serpstatbot прибавляет 2 миллиардов новейших ссылок и обходит 2,5 миллиона доменов в день.

Serpstat считает ссылки с поддоменов наружными. Ежели на сайте есть линковка меж поддоменами, он указывает для вашего домена, что это наружные ссылки.

У Serpstat маленькое количество API-лимитов, они тарифицируют конкретно ответы, но не запросы, которые вы делаете, выходит, чтоб смонтировать данные по ссылкам необходимо затратить много ресурсов. Данные там довольно грязные с ними тяжело работать.

Главные наблюдения

Ссылки с высочайшим Trust flow – меньше 1 млн превосходно коррелируют с положительной динамикой позиций.

В YMYL-тематиках (медицина, юриспруденция, деньги) , где контент может воздействовать на жизнь и здоровье жителей нашей планеты, Google устремляется предоставлять честные ответы, потому употребляет такие характеристики, как авторитетность ресурса. Для всех других (не-YMYL) тем оказывается, что низкокачественные ссылки работают так же, как и высококачественные.

Cсылки, которые предоставляют Advodka, Keys.so pr-cy и иные анализаторы НЕ надобно накрывать в disavow. Часть из их – превосходные. Ними можнож бустить странички доноров.

Как регистрировать ссылки

Ранее проставив ссылку на страничку донора, мы сходу высылали ее в addURL. Сейчас инструмент от Google работать закончил.

- Twitter: не работает. Индексируется наименее 3% ссылок.

- Для ссылок Tier2, Tier3: годятся любые приборы типа Xrumer, Senuke Xcr и т.д., но избавляться от footprint-ов недешево для целей индексации.

- Дорвеи: превосходный метод, но недешево и одни те же домены нельзя использовать для индексации непрерывно, т.к. они живо попадают в бан.

- 301: http://linkbox.pro/ru/google-addurl (несколько трастовых страничек без футпринтов – прибавляем URL с редиректом в GSC и отправляем на индексацию) .

Желая это удивительно обходить Google странички, которые отдают 301, но бот обходит эту страничку, так увеличивается возможность прибавления ее в поиск. Выходит потрясающий инструмент. НО у нас нет доступа к самим донорам, откуда пришел редирект.

Выводы

- Высококачественные метрики ссылок меньше коррелируют с позициями, чем количественные.

- Приборы ссылочного анализа, основанные на big data, содержат много неактуальных, запятанных данных не подходят для анализа работы линкбилдеров.

- Проиндексировать свои ссылки дешевле, чем покупать новейшие.

Видеозапись доклада

Презентация доклада доступна по ссылке.

Комментариев 0